Soit $n$ un entier naturel non nul et $\F$ un corps.

Pour tout $i\in\llbracket 1,n \rrbracket$ notez $L_i$ la forme linéaire de $\F^n$ dans $\F$ définie par $\forall (x_1,\dots,x_n)\in\F^n, L_i(x_1, \dots, x_n) = x_i.$

Soit $E$ un sous-espace vectoriel de $\F^n$ non réduit au singleton $\{0\}.$

Montrez qu’il existe une première coordonnée pivot

L’ensemble $A_1 = \{i\in\llbracket 1,n \rrbracket, \exists x\in E, L_i(x)\neq 0\}$ est non vide : cela traduit qu’il existe un vecteur non nul appartenant à $E$.

$A_1$ est une partie de $\N$ non vide. Notez $i_1$ son minimum.

Il existe un vecteur $x_1\in E$ tel que $L_{i_1}(x_1)\neq 0$ et $\forall x\in E, \forall i\in\llbracket 1,n \rrbracket, i<i_1 \Longrightarrow L_i(x)=0.$ Par la suite, des implications de ce type seront notées plus simplement : $\forall x\in E, \forall i < i_1, L_i(x)=0.$

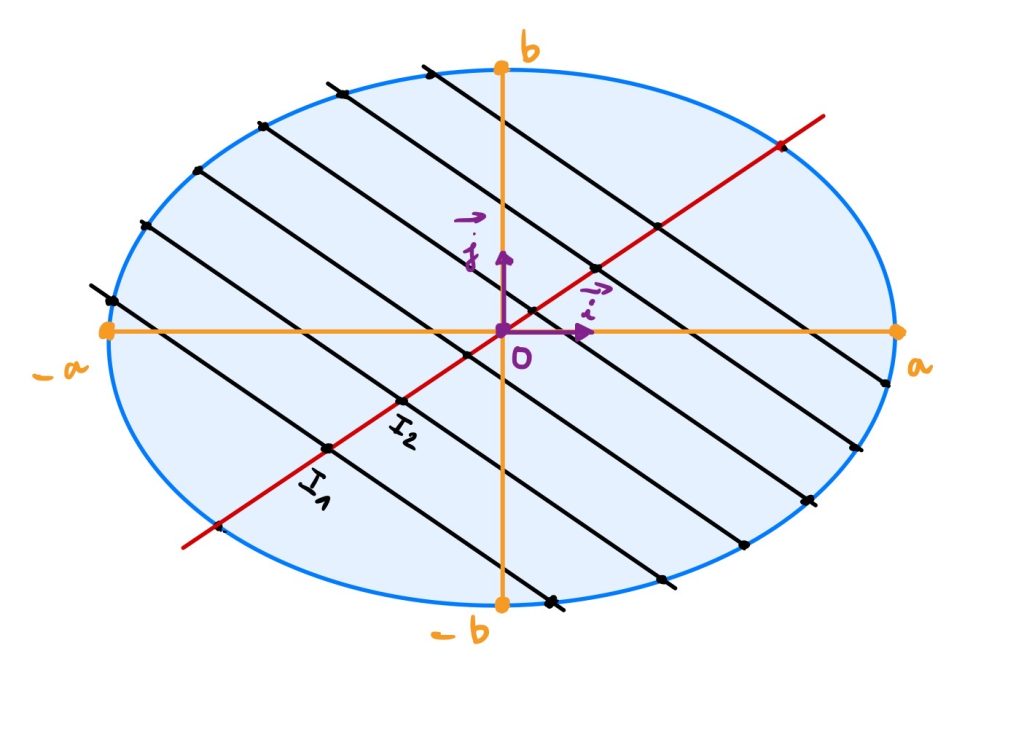

Multipliez le vecteur $x_1$ par $\dfrac{1}{L_{i_1}(x_1)}$, vous obtenez un vecteur $y_1 = \dfrac{1}{L_{i_1}(x_1)} x_1$ de $E$ tel que $L_{i_1}(y) = 1$ et $\forall i<i_1, L_i(y)=0.$

$i_1$ désigne le premier numéro de coordonnée pour lequel il existe un vecteur appartenant à $E$ de la forme $(0,\dots,0,1,\times, \dots, \times).$

$i_1$ sera appelé « coordonnée pivot » pour l’espace vectoriel $E$.

Cela conduit à la définition suivante.

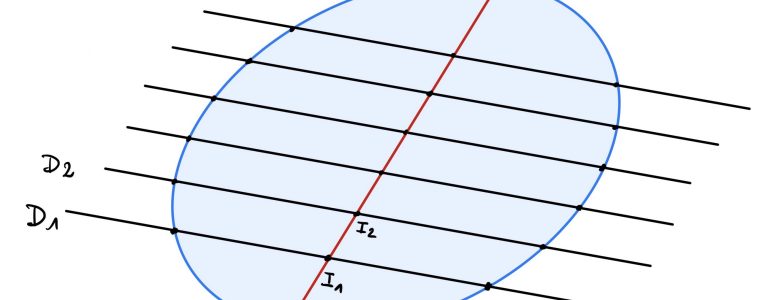

Les coordonnées pivot dans le cas général

Pour tout $i\in\llbracket 1,n \rrbracket$ le nombre $i$ est appelé « coordonnée pivot » pour l’espace vectoriel $E$, si et seulement s’il existe un vecteur $x\in E$ tel que $L_i(x)=1$ et $\forall j < i, L_j(x)=0.$

Il existe au plus $n$ coordonnées pivots pour l’espace $E$. En notant $r$ le nombre d’éléments de l’ensemble formé par toutes les coordonnées pivots de $E$, vous pouvez noter $\{i_{1}, \dots, i_r\}$ avec $1\leq i_1<\dots<i_r\leq n$ l’ensemble des coordonnées pivots de $E$.

Par définition des coordonnées pivots, pour tout $j\in\llbracket 1, r\rrbracket$, il existe un vecteur $x_{i_j}\in E$ tel que $L_{i_j}(x_{i_j}) = 1$ et $\forall k < i_j, L_k(x_{i_j})=0.$

On dira qu’un vecteur $x\in E$ est un vecteur pivot de $E$ si et seulement s’il existe un nombre $i$ compris entre $1$ et $n$ tel que $L_i(x)=1$ et $\forall j < i, L_j(x)=0.$

Existence et unicité de vecteurs pivots

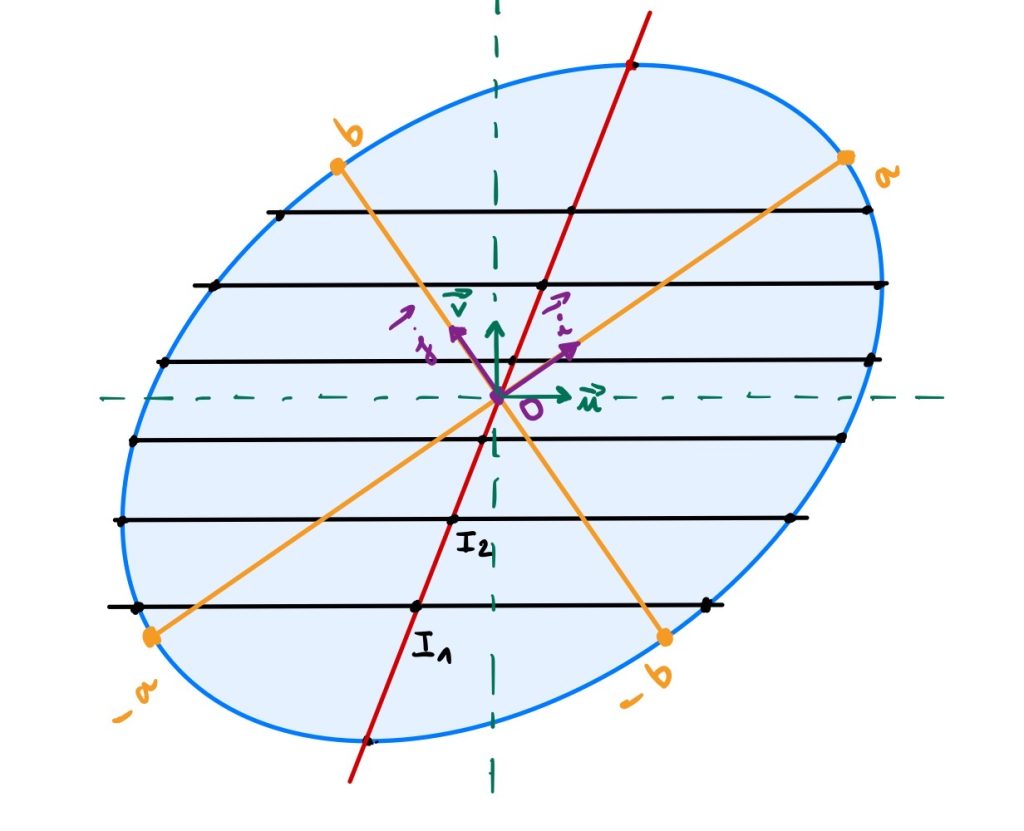

Rappelez-vous que $\{i_{1}, \dots, i_r\}$ désigne toutes les coordonnées pivots de $E$. Vous allez montrer un résultat plus fort, l’existence et l’unicité pour chaque $j$ compris entre $1$ et $r$, d’un vecteur pivot $x_{i_j}$ tel que : $L_{i_j}(x_{i_j})=1$, $\forall k\in\llbracket 1, r\rrbracket, i_k \neq i_j \Longrightarrow L_{i_k}(x_{i_j})=0.$

Montrez d’abord l’unicité

$\forall j\in\llbracket 1, r\rrbracket, \exists! x_{i_j}\in E$ tel que $L_{i_j}(x_{i_j}) = 1$ et $\forall k\in\llbracket 1, r\rrbracket, i_k \neq i_j \Longrightarrow L_{i_k}(x_{i_j})=0.$

Soit $j$ appartenant à l’ensemble $\llbracket 1, r\rrbracket.$ Supposez qu’il existe deux vecteurs $x\in E$ et $y\in E$ tels que $L_{i_j}(x) = L_{i_j}(y)=1$ et $\forall k\in\llbracket 1, r\rrbracket, i_k \neq i_j \Longrightarrow L_{i_k}(x)=L_{i_k}(y)=0.$

Alors $\forall k \in \{i_{1}, \dots, i_r\}, L_k(x-y)=0.$ Si le vecteur $x-y$ n’était pas nul, il existerait $p\in\llbracket 1,n \rrbracket$ tel que $L_p(x-y)\neq 0.$ Soit $\ell$ le plus petit entier $p\in\llbracket 1,n \rrbracket$ tel que $L_p(x-y)\neq 0.$ Alors $\forall i<\ell, L_i(x-y)=0.$ Multipliez le vecteur $x-y$ par $\dfrac{1}{L_{\ell}(x-y)}$, pour constater que $z = \dfrac{1}{L_{\ell}(x-y)} (x-y)$ vérifie $L_{\ell}(z)=1$ et $\forall i < \ell, L_{i}(z)=0.$ Il en résulte que $\ell$ est une coordonnée pivot de $E$. Donc $\ell \in \{i_{1}, \dots, i_r\}$ et donc $L_{\ell} (x-y)=0$, ce qui contredit la définition de $\ell$. Ainsi $x=y$ et l’unicité est démontrée.

Montrez ensuite l’existence

C’est la partie la plus délicate. Elle est basée sur le processus de Gauss-Jordan.

Soit $j$ appartenant à l’ensemble $\llbracket 1, r\rrbracket.$ Le nombre $i_j$ est une coordonnée pivot de $E$ donc il existe un vecteur pivot $x\in E$ tel que $L_{i_j}(x) = 1$ et $\forall k < i_j, L_k(x)=0.$

Pour tout entier $s$ compris entre $j+1$ et $r$, vous allez montrer qu’il existe un vecteur $y\in E$ tel que $L_{i_j}(y) = 1$, $\forall k\in \{i_{j+1}, \dots, i_{s}\}, L_k(y)=0$ et $\forall k < i_j, L_k(y)=0.$

Vous procédez par récurrence limitée. Pour tout entier $s$ compris entre $j+1$ et $r$, notez $P(s)$ la propriété : « il existe un vecteur $y\in E$ tel que $L_{i_j}(y) = 1$, $\forall k\in \{i_{j+1}, \dots, i_{s}\}, L_k(y)=0$ et $\forall k < i_j, L_k(y)=0.$ »

Initialisation. $i_{j+1}$ est une coordonnée pivot donc il existe un vecteur $z\in E$ tel que $L_{i_{j+1}}(z)=1$ et $\forall k < i_{j+1}, L_k(z)=0.$ Considérez le vecteur $y=x -L_{i_{j+1}}(x) z.$ Par combinaison linéaire, $y\in E.$ La condition $\forall k < i_j, L_k(y)=0$ est satisfaite puisqu’elle l’est pour $z$ et pour $x$ vu que $i_j < i_{j+1}.$ Vous avez $L_{i_j}(y)=L_{i_j}(x)-L_{i_{j+1}}(x) L_{i_j}(z)$, or $L_{i_j}(z)=0$ donc $L_{i_j}(y)=L_{i_j}(x) = 1.$ D’autre part, $L_{i_{j+1}}(y) =L_{i_{j+1}}(x)-L_{i_{j+1}}(x) L_{i_{j+1}}(z) $ or $L_{i_{j+1}}(z)=1$ donc $L_{i_{j+1}}(y) =L_{i_{j+1}}(x)-L_{i_{j+1}}(x) = 0.$ La propriété $P(j+1)$ est vérifiée.

Hérédité. Soit $s$ un entier compris entre $j+1$ et $r-1$. Supposez $P(s)$.

Il existe donc un vecteur $z\in E$ tel que $L_{i_j}(z) = 1$, $\forall k\in \{i_{j+1}, \dots, i_{s}\}, L_k(z)=0$ et $\forall k < i_j, L_k(z)=0.$

$i_{s+1}$ étant une coordonnée pivot, il existe un vecteur $a\in E$ tel que $L_{i_{s+1}}(a)=1$ et $\forall k < i_{s+1}, L_k(a)=0.$

Considérez le vecteur $y=z -L_{i_{s+1}}(z) a$, alors $y\in E$ et la condition $\forall k < i_j, L_k(y)=0$ est satisfaite. Vous avez $L_{i_j}(y)=L_{i_j}(z)-L_{i_{s+1}}(z) L_{i_j}(a)$, or $L_{i_j}(a) = 0$ donc $L_{i_j}(y)=L_{i_j}(z) = 1.$ Soit $k$ appartenant à $\{i_{j+1}, \dots, i_{s}\}$. $L_k(y) = L_k(z)-L_{i_{s+1}}(z) L_k(a)$, or $L_k(z) = 0$ et $L_k(a) = 0$ donc $L_k(y)=0.$ Pour le dernier calcul, $L_{i_{s+1}}(y)= L_{i_{s+1}}(z)-L_{i_{s+1}}(z) L_{i_{s+1}}(a)$, or $L_{i_{s+1}}(a) = 1$ donc $L_{i_{s+1}}(y)= L_{i_{s+1}}(z)-L_{i_{s+1}}(z) = 0.$ Le vecteur $y$ convient et la propriété $P(s+1)$ est vérifiée.

Par récurrence limitée, la propriété $P(r)$ est satisfaite.

Prolongement

Veillez à lire l'article 115 qui vous expliquera pourquoi les vecteurs pivots constituent, en fait, une base de $E.$