Descriptif du faisceau

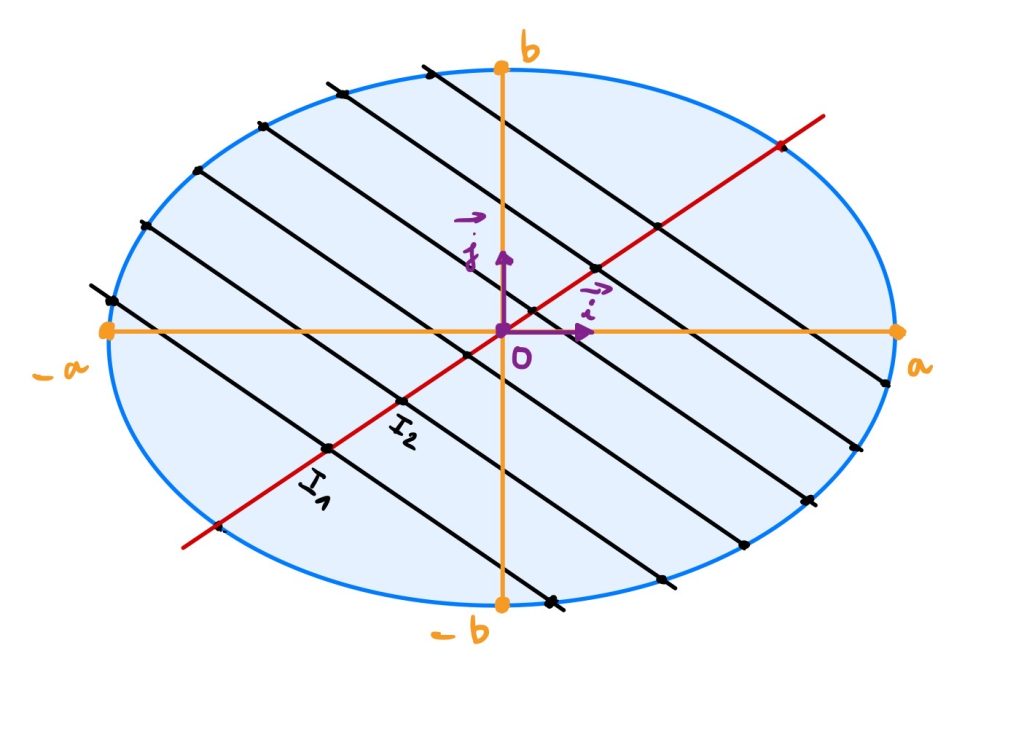

Tout d’abord, décrivons la partie géométrique, on se donne une ellipse de demi-grand axe $a>0$ et de demi-petit axe $b>0$ qui n’est pas un cercle : $0<b<a.$

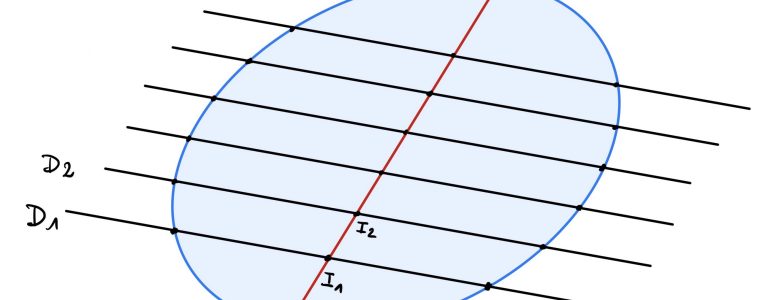

On considère des droites $D_1$, $D_2$… toutes parallèles entre elles, coupant ladite ellipse en deux points chacune, ce qui s’appelle un faisceau.

On considère alors les milieux des points d’intersection : la droite $D_1$ coupe l’ellipse en deux points dont on note $I_1$ le milieu, et ainsi de suite, conformément au schéma ci-dessus.

Ce qui est tout à fait remarquable, c’est que l’ensemble de ces milieux est inclus dans droite qui passe par le centre de l’ellipse.

Note : le lecteur qui connaît la notion d’affinité et ses propriétés pourra démontrer très rapidement ce résultat.

Dans cet article, le résultat sera démontré avec une approche qui ne déforme pas l’ellipse.

Première approche pour démontrer ce résultat

Le repère dans lequel l’ellipse a l’équation la plus simple est un repère $(O,\vv{i},\vv{j})$, $O$ étant le centre de l’ellipse, les vecteurs $\vv{i}$ et $\vv{j}$ dirigeant le grand axe et le petit axe de ladite ellipse.

Soient $D_1$ et $D_2$ deux droites du faisceau.

Notez $ux+vy+w=0$ avec $(u,v)\neq(0,0)$ une équation cartésienne de $D_1$, puis $u’x+v’y+w’=0$ avec $(u’,v’)\neq (0,0)$ une équation cartésienne de $D_2$. Comme elles sont parallèles, vous avez l’égalité $uv’ – u’v=0.$

Obtenir les deux points d’intersection de $D_1$ avec l’ellipse, c’est trouver les solutions du système :

$\left\{\begin{align*}\dfrac{x^2}{a^2}+\dfrac{y^2}{b^2}=1 \\ ux+yv+w = 0\end{align*}\right.$

Notez $\left(x_1^{(1)},y_1^{(1)}\right)$ et $\left(x_2^{(1)},y_2^{(1)}\right)$ les coordonnées des deux points obtenus.

Obtenir lesdeux points d’intersection de $D_2$ avec l’ellipse, c’est trouver les solutions du système :

$\left\{\begin{align*}\dfrac{x^2}{a^2}+\dfrac{y^2}{b^2}=1 \\ u’x+y’v+w’ = 0\end{align*}\right.$

Notez $\left(x_1^{(2)},y_1^{(2)}\right)$ et $\left(x_2^{(2)},y_2^{(2)}\right)$ les coordonnées des deux points obtenus.

Il va vous falloir former les deux milieux $\left(\dfrac{x_1^{(1)}+x_2^{(1)}}{2};\dfrac{y_1^{(1)}+y_2^{(1)}}{2}\right)$ et $\left(\dfrac{x_1^{(2)}+x_2^{(2)}}{2};\dfrac{y_1^{(2)}+y_2^{(2)}}{2}\right)$ puis démontrer l’alignement de ces deux points avec l’origine du repère.

Est-ce possible ? Oui, mais ce n’est pas l’approche que l’on va privilégier.

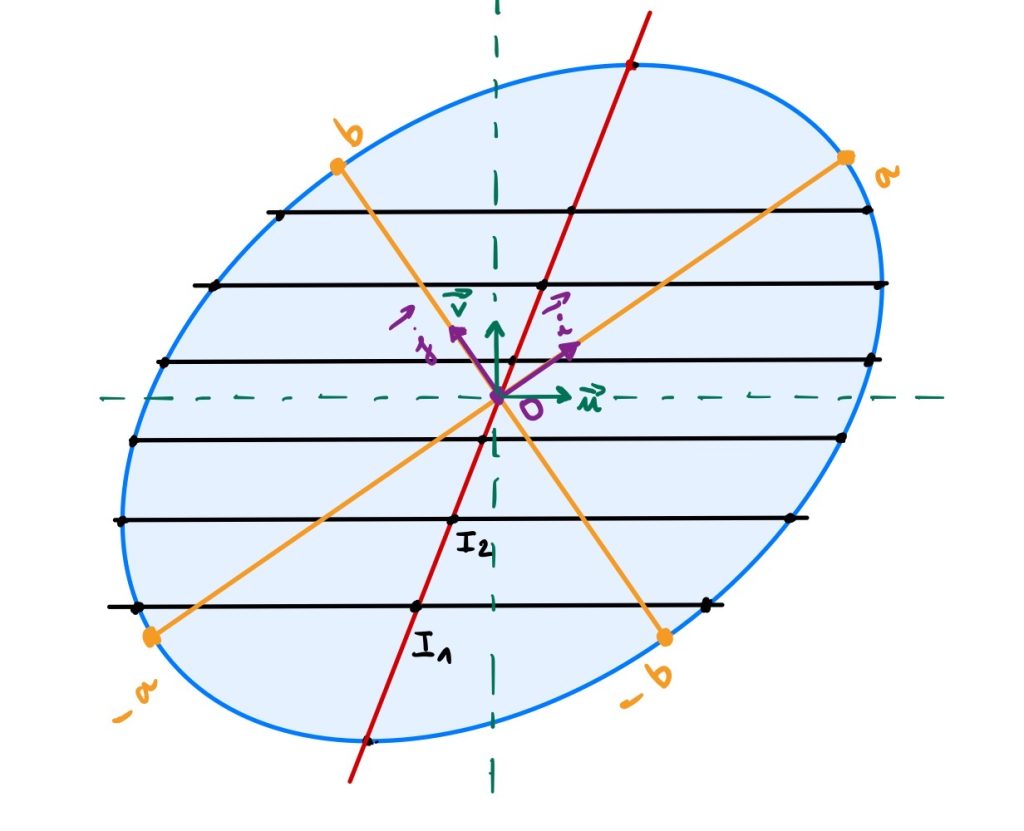

Changez les axes du repère par une rotation

Au lieu de travailler dans un repère orthonormé ayant des axes parallèles à ceux de l’ellipse, il est tout à fait possible de changer de repère par rotation et de considérer que la droite $D_1$ est horizontale, dans le nouveau repère, avec une équation de la forme $Y=k$. Notez $O$ le centre de l’ellipse et $\vv{i}$ et $\vv{j}$ deux vecteurs unitaires orthogonaux dirigés selon les axes de l’ellipse.

Notez $\vv{u}$ et $\vv{v}$ les deux vecteurs obtenus par rotation, d’angle $\alpha$ choisi pour que $\vv{u}$ soit un vecteur qui dirige $D_1$, $D_2$, ce qui change le point de vue conformément au dessin ci-dessous.

Matriciellement, le vecteur $\vv{OM}$ est égal au produit $\begin{pmatrix}x & y \end{pmatrix}\begin{pmatrix} \vv{i}\\ \vv{j}\end{pmatrix}.$ Or, $\begin{pmatrix} \vv{u}\\ \vv{v}\end{pmatrix} = \begin{pmatrix} \cos \alpha & \sin \alpha \\ -\sin\alpha & \cos\alpha \end{pmatrix} \begin{pmatrix} \vv{i}\\ \vv{j}\end{pmatrix}.$

Soit $M$ un point du plan. Notez $(x,y)$ ses coordonnées dans le repère orthonormé $(O,\vv{i},\vv{j})$ et $(X,Y)$ ses coordonnées dans l’autre repère $(O,\vv{u},\vv{v}).$

\begin{align*}

\vv{OM} &= \begin{pmatrix}X & Y \end{pmatrix}\begin{pmatrix} \vv{u}\\ \vv{v}\end{pmatrix}\\

&=\begin{pmatrix}X & Y \end{pmatrix} \begin{pmatrix} \cos \alpha & \sin \alpha \\ -\sin\alpha & \cos\alpha \end{pmatrix} \begin{pmatrix} \vv{i}\\ \vv{j}\end{pmatrix} \\

&= \begin{pmatrix}X\cos\alpha - Y\sin\alpha & X\sin\alpha+Y\cos\alpha \end{pmatrix}\begin{pmatrix} \vv{i}\\ \vv{j}\end{pmatrix}.

\end{align*}Il vient donc $\left\{\begin{align*}x &= X\cos\alpha – Y\sin\alpha \\

y &= X\sin\alpha+Y\cos\alpha \end{align*}\right.$

Considérez la matrice $A = \begin{pmatrix} \cos\alpha & -\sin\alpha \\ \sin\alpha & \cos\alpha \end{pmatrix}.$ Elle est orthogonale, puisque $A (^{t}A) = (^{t}A) A = I.$

La relation $\begin{pmatrix}x \\ y \end{pmatrix} = A \begin{pmatrix}X \\ Y \end{pmatrix} $ est équivalente à $\begin{pmatrix}X \\ Y \end{pmatrix} = (^{t}A) \begin{pmatrix}x \\ y \end{pmatrix}.$

Obtenez la nouvelle équation de l’ellipse

Quel que soit $(x,y,X,Y)\in\R^4$ vérifiant $\left\{\begin{align*}x &= X\cos\alpha – Y\sin\alpha \\

y &= X\sin\alpha+Y\cos\alpha \end{align*}\right.$

vous observez l’équivalence :

\begin{align*}

\dfrac{x^2}{a^2}+\dfrac{y^2}{b^2}=1 &\Longleftrightarrow \dfrac{(X\cos\alpha - Y\sin\alpha)^2}{a^2}+\dfrac{(X\sin\alpha+Y\cos\alpha)^2}{b^2}=1 \\

&\Longleftrightarrow \dfrac{(\cos^2\alpha) X^2+(\sin^2\alpha) Y^2-\sin(2\alpha)XY}{a^2}+\dfrac{(\sin^2\alpha) X^2+(\cos^2\alpha)Y^2+\sin(2\alpha)XY}{b^2}=1\\

&\Longleftrightarrow \left(\dfrac{\cos^2\alpha}{a^2}+\dfrac{\sin^2\alpha}{b^2}\right)X^2+\left(\dfrac{\sin^2\alpha}{a^2}+\dfrac{\cos^2\alpha}{b^2}\right)Y^2+\left(\dfrac{1}{b^2}-\dfrac{1}{a^2}\right)\sin(2\alpha)XY = 1.

\end{align*}Dans le repère $(O,\vv{u},\vv{v})$ l’ellipse a pour équation :

\left(\dfrac{\cos^2\alpha}{a^2}+\dfrac{\sin^2\alpha}{b^2}\right)X^2+\left(\dfrac{\sin^2\alpha}{a^2}+\dfrac{\cos^2\alpha}{b^2}\right)Y^2+\left(\dfrac{1}{b^2}-\dfrac{1}{a^2}\right)\sin(2\alpha)XY = 1.Calculez les coordonnées d’un des milieux

Soit $D$ la droite horizontale d’équation $Y=k$. On suppose que $D$ coupe l’ellipseen deux points distincts. Vous noterez $(X_1,k)$ et $(X_2,k)$ les coordonnées de ces deux points.

Alors $X_1$ et $X_2$ sont les deux solutions de l’équation de degré 2 :

\left(\dfrac{\cos^2\alpha}{a^2}+\dfrac{\sin^2\alpha}{b^2}\right)X^2+k\left(\dfrac{1}{b^2}-\dfrac{1}{a^2}\right)\sin(2\alpha)X+\left(\dfrac{\sin^2\alpha}{a^2}+\dfrac{\cos^2\alpha}{b^2}\right)k^2 -1 =0.Vous noterez que le coefficient dominant est non nul. En effet, si, par l’absurde, vous aviez $\dfrac{\cos^2\alpha}{a^2}+\dfrac{\sin^2\alpha}{b^2}=0$, alors les deux carrés $\dfrac{\cos^2\alpha}{a^2}$ et $\dfrac{\sin^2\alpha}{b^2}$ seraient nuls et donc $\cos\alpha = \sin\alpha = 0$, ce qui contredit l’équation fondamentale $\cos^2\alpha + \sin^2\alpha = 1.$

En utilisant la formule qui donne la somme des deux racines en fonction des coefficients d’une équation polynomiale de degré 2, vous obtenez :

X_1+X_2 = \dfrac{k\sin(2\alpha)\left(\dfrac{1}{a^2}-\dfrac{1}{b^2}\right)}{\dfrac{\cos^2 \alpha}{a^2}+\dfrac{\sin^2\alpha}{b^2}}.Pour plus de lisibilité, posez $m =\left(\dfrac{1}{a^2}-\dfrac{1}{b^2}\right) \dfrac{\sin(2\alpha)}{\dfrac{2\cos^2 \alpha}{a^2}+\dfrac{2\sin^2\alpha}{b^2}}$. Le milieu des deux points d’intersection de $D$ avec l’ellipse a pour coordonnées $(km; k)$, il est donc situé sur la droite d’équation $mY = X$ qui est passe par l’origine $O$ du repère qui est aussi le centre de l’ellipse, ce qui démontre le résultat annoncé.

Prolongement

Partant d’une ellipse déjà dessinée, avec une règle et un compas :

- pourriez-vous construire le centre de cette ellipse ?

- pourriez-vous retrouver son grand axe et son petit axe ?